Оновлення автокодерів

Cline v3.6.10

Головне, що з версії 3.6 додали Cline API як опцію постачальника, що дозволяє новим користувачам зареєструватися та почати користуватися Cline безкоштовно (мені подарували $0.5) без API ключів.

Зробили окремий сайт https://cline.bot/ де можна створити акаунт (лише через Google або GitHub) і поповнювати його грошима. Кредити, придбані за допомогою кредитної картки, передбачають загальну комісію у розмірі 5% + $0.35 + податок.

На сайті є блог, де розповідають про досвід використання. Також всі MCP плагіни тепер можна подивитися на https://cline.bot/mcp-marketplace.

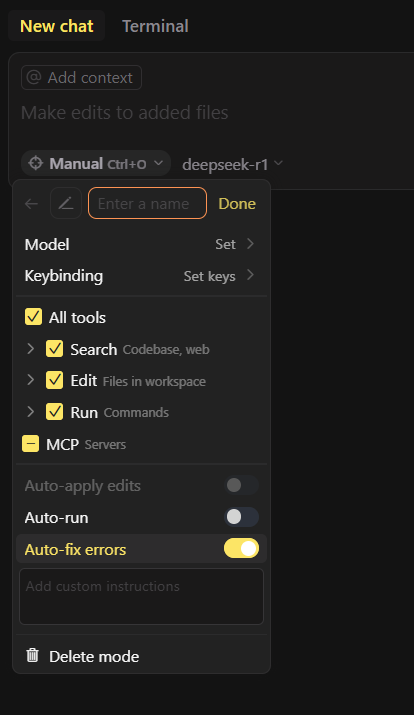

Додали налаштування для вимкнення зміни моделі у режимах Планування/Дія (для нових користувачів за замовчуванням вимкнено). Мені подобається, коли є можливість налаштувати різні моделі для різних режимів. Тепер, якщо поставити галочку, з’являться дві вкладки з повною настройкою різних моделей, включаючи власну кастомну інструкцію.

Додали у документацію приклад інструкції Cline Memory Bank.

Для тих, хто хоче допомогти покращати продукт додали можливість включити телеметрію, але добре що за замовчування вимкнена.

Roo Code v3.8.4

Приємно, що є конкуренція.

Roo йде іншим шляхом, тут немає каталогу MCP, зате добре розширили функціонал створення різних режимів з кастомними системними інструкціями. Додали підтримку файлів .rooignore. Краще пророблені контрольні точки, режим декількох вікон та комунікація між підзавданнями та основним завданням.

До цікавого режиму The VS Code Language Model API, який дозволяє запускати моделі, надані іншими розширеннями VS Code (включаючи, але не обмежуючись, GitHub Copilot) додали ще "Human Relay" як постачальника.

Тобто плагін нам видає текст запита, ми як людина робимо релей: копіюємо-вставляємо на сайт у чат, потім вставляємо в вікно відповідь. Наразі це єдиний спосіб використовувати Grok 3. Звичайно, було б добре, якби це робив якийсь агент на рівні операційної системи, але що є, те є.

Для тих, хто хоче допомогти покращати продукт додали можливість включити телеметрію, питає чи включити при першому запуску.

#cline #roo #prompts #mcp